HDR製品のご案内#2 – QM8700、LinkX

さて、HDR(/HDR100)製品のご案内、後編となる、QM8700、CS8500スイッチとLinkXケーブル編をお送りさせていただきます。

スイッチ製品

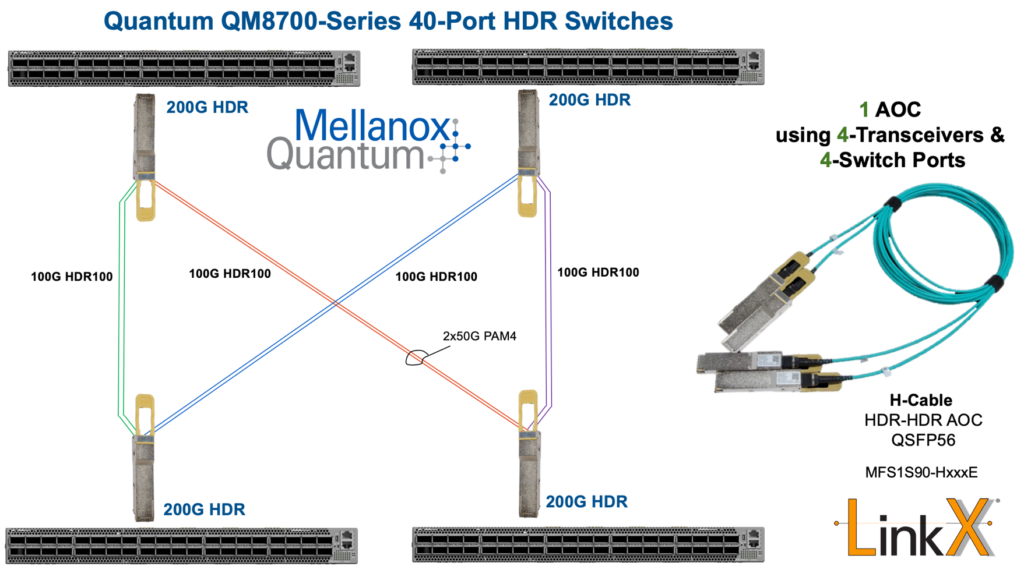

メラノックスでは、HDR InfiniBand に「Quantum」と呼ぶスイッチシリコンを開発し同社のHDR対応スイッチ製品に搭載しています。Quantumシリコンは、HDR InfiniBand 40ポートをノン・ブロッキングで提供する能力を提供しており、このシリコンを活用する、QM8700シリーズも40ポートのHDR InfiniBand スイッチとなります。同社のQSFPタイプのコネクタを持つ、EDR InfiniBandまでの1U高のスイッチは、最大でも36ポートなのに対し、HDR世代では、4ポート分増えた形となります。

(以下の写真は、ManagedタイプのQM8700)

x86ベースのCPUカードの搭載によって、例えば周囲温度によりファンの回転数を制御するといった筐体管理機能と、最大2千ノードまで管理可能なサブネットマネージャなど、ファブリック管理機能を搭載するManagedスイッチと、Unmanaged スイッチそれぞれで、P2C(電源ユニット側からコネクター側に空気が流れる)通常エアフロー版とその逆となるC2Pのリバースエアフロー版が提供されています。ちなみに、Mellanox のハードウェアユーザーマニュアルの「Specification」項によれば、CPUには、x86 ComEx Broadwell D-1508 (サーバクラスのPentium® D-1508 )を搭載しており、これは、EDR スイッチが搭載する CPUに対し、約3倍に近い性能差を誇っています。またスイッチ自体、200 Gb/s x 40ポート x 2 全二重=1.6Tb/s の集約帯域幅をサポートする、HDR でのノンブロッキングスイッチとなっています。

ところで、前半となるHDR製品のご案内#1をお読みいただいた方は、何故、EDR InfiniBand があるのに、同じ100Gb/sのHDR100が出たのだろう? と思われたかと思います。

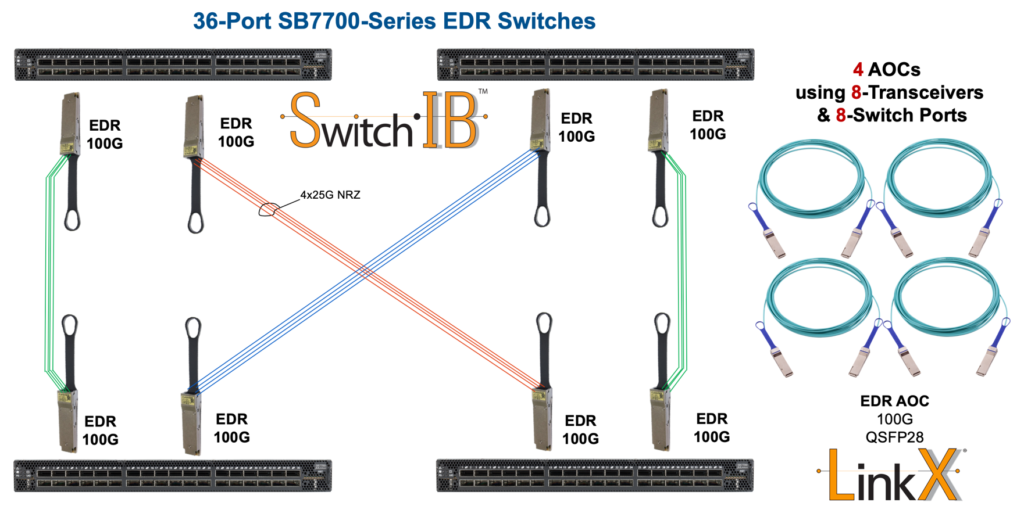

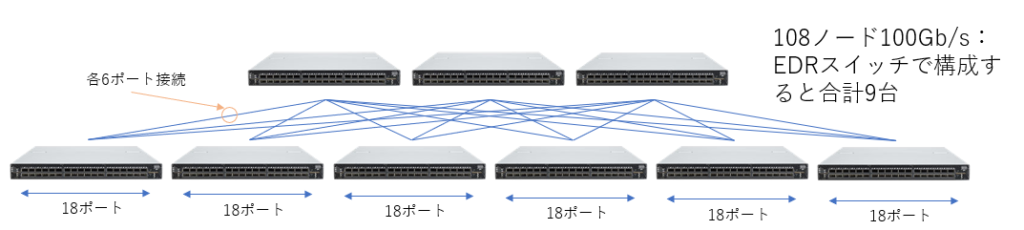

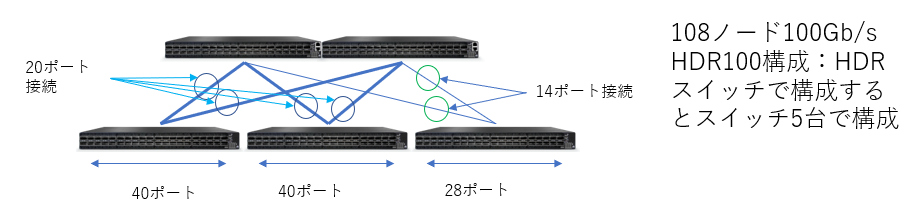

おさらいとなりますが、HDRでは、1レーン50Gb/s を 4レーンを使い、200Gb/s の転送速度を提供するのに対し、HDR100では、半分の2レーンのみを使う所がポイントとなります。MellanoxのHDR対応スイッチでは、すべてのポートをHDR100 モードに設定することができ、1UサイズのQM8700スイッチでは、80ポートのHDR100スイッチとしても活用できます。このHDR100モードを活用すれば、これまでのEDRでの接続に対し大幅にスイッチの数を削減することが可能になります。以下の例では、100Gb/s ノンブロッキングのFAT Tree 108ノードの構成となりますが、EDRで構成する場合、スイッチ9台が必要になるのに対し、HDR100では、スイッチ5台で構成することが可能です。

同様のことが、CS8500、ディレクタースイッチにも言えます。CS8500は、最大800ポートを搭載可能な29U高のディレクタースイッチであり、内部でSpine及びLeaf の各ブレードがミッドプレーンを介してFat Tree構成で接続されています。各Leafブレードには、スイッチシリコン、「Quantum」 が2つ搭載されており、サーバを接続するポート側に40のHDRポート、ミッドプレーンを介して上位となるSpineブレード側にも40ポート分HDR接続がなされるように設計されています。このすべてのポートをHDR100として活用すれば、1,600ノードのHDR100スイッチとしても活用可能となります。このディレクタースイッチ、今回より、より冷却効率の高い液冷式となっています。

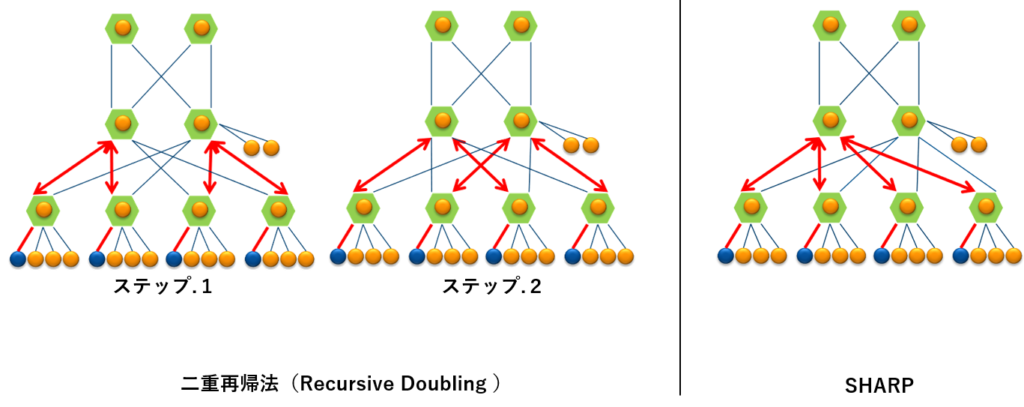

さて、HDR スイッチのもう一つの特徴として「SHARP™:Scalable Hierarchical Aggregation and Reduction Protocol」と呼ばれる機能が搭載されています。InfiniBandでは、サブネットマネージャが経路情報を管理しているのですが、基本的には、発見した機器に対し均等になるように計算した経路情報を各機器に配信しており、一旦経路が確定した後は、ケーブルが抜かれる・新たな機器が追加されるなどの状態遷移が起こらなければ、そのままの経路が維持されます。この計算された経路情報には、実際の演算で活用される個々の経路を通る頻度などが反映されているものではないため、必ずしもすべての状況においては、最適な経路が引かれているわけではありません。Mellanoxでは、「In-network computing」を謳っており、例えば、MPIによる集団通信を行う場合、経路によっては何段かの段数を経て演算が行われます。この何段かのパスを経路を動的に変更することで、演算にかかる段数を減らすことができれば、より短い時間でMPIの演算を終えることが出来る、つまり演算性能を上げることにつながります。これを具現化する一つの手法がSHARP機能であり、接続されたカード上で動作するデーモン等からの経路に関する情報を収集、スイッチ内のサブネットマネージャに介在し動的に論理的な経路設定を変更することで集団通信にかかわる演算工数を減らしています。

SHARPの機能自体は、1世代前のSB7800シリーズのEDR スイッチより対応しているのですが、HDRスイッチでは、機械学習などで活用されるよりメッセージサイズの大きな演算にも対応した第二世代のSHARPとなっています。

ケーブル製品

DACケーブル

HDRでは、銅線(DAC:Direct Attach Copper)ケーブルは、0.5m~2m まで提供されます。EDR世代までは3m長まで提供されていましたので、この点注意が必要です。このため、2.5m以降の距離は、AOC(Active Optical Cable:簡単に言えば両端に最初からQSFPコネクタがついている光ケーブルです。)で、対応する形になります。

スピリッターケーブル

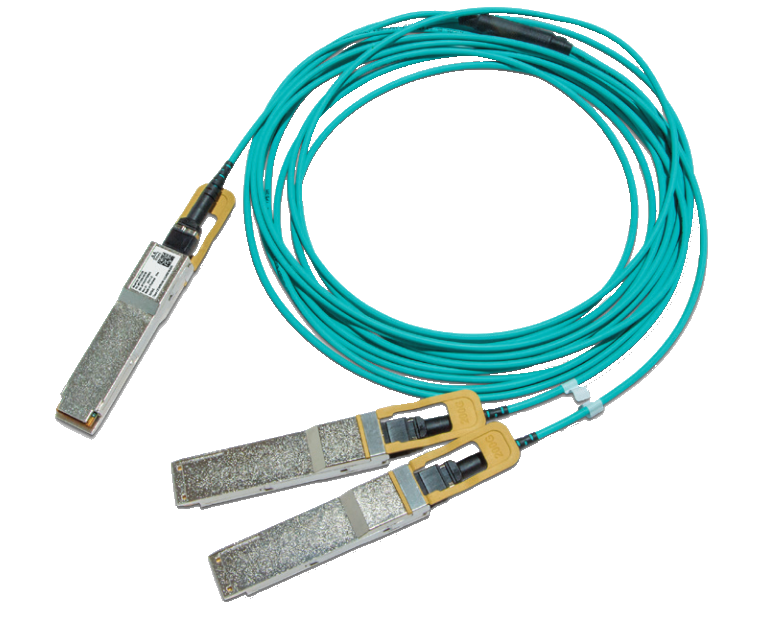

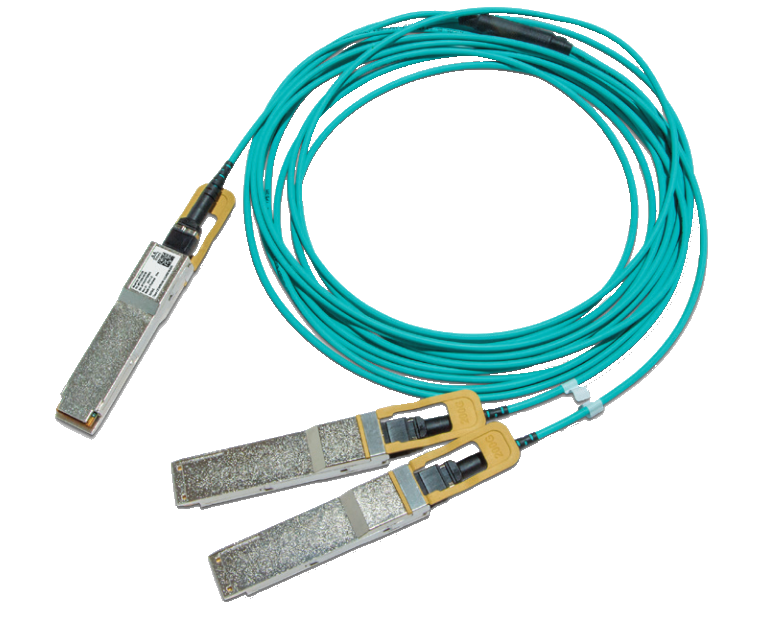

HDR 世代では、InfiniBand ではこれまでになかった、2レーンのHDR100が登場したことにより、スイッチのHDRポートより2ポートのHDR100を取り出すケーブルが、DAC 及びAOCそれぞれで用意されています。(以下は、DAC ケーブルのイメージです。)

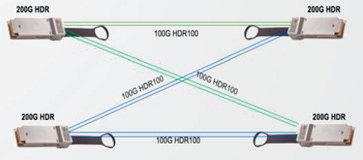

このケーブルは、内部で、左側のコネクタのレーン1-2が右話上側のコネクタのレーン1-2に、左側のコネクタのレーン3-4を右側下段のコネクタのレーン1-2に接続する形で、スイッチのHDRポートを、2つのHDR100ポートとしての活用を可能にしています。(スイッチ側でも、HDR100にポート設定を行う必要がございます。)

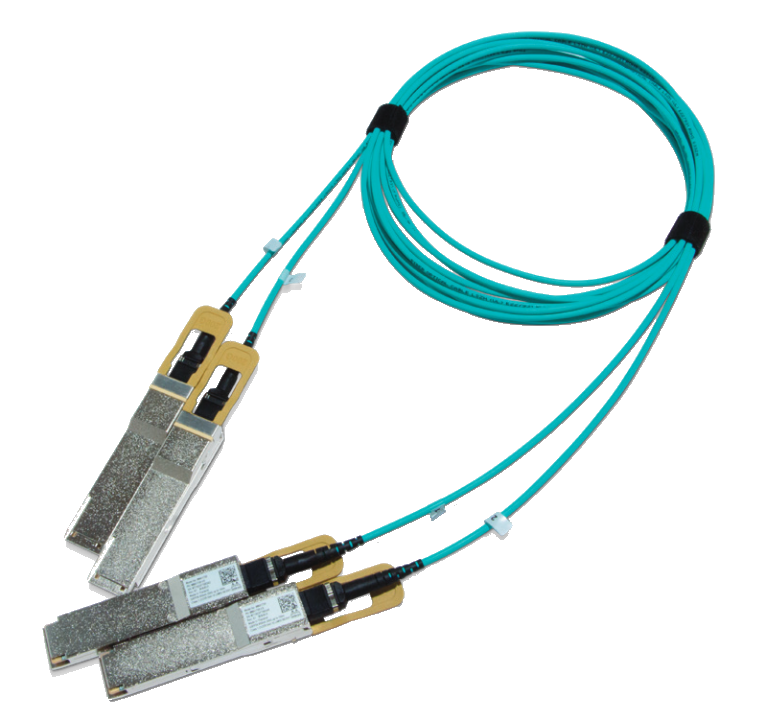

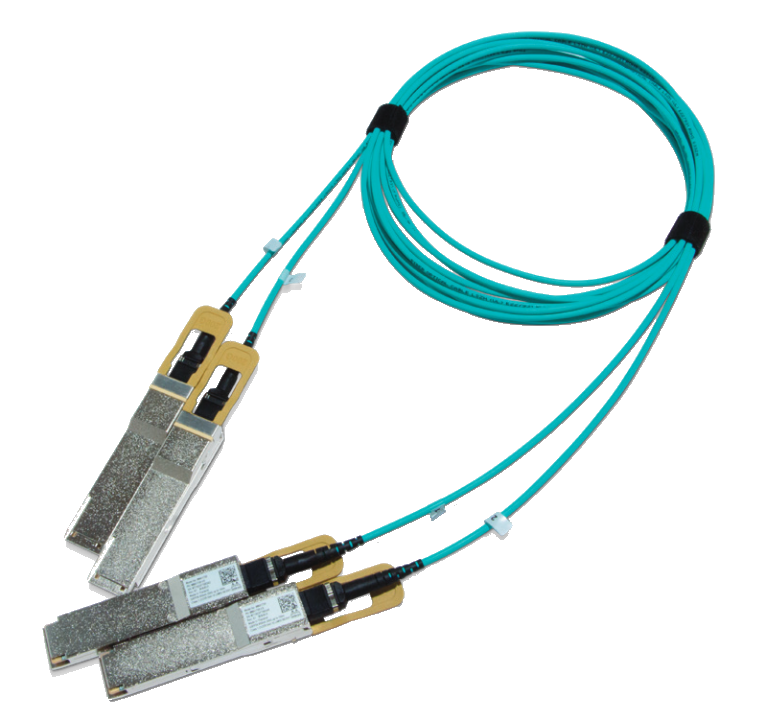

また、新たに登場したH型のAOCでは、Spine-Leafの構成において、HDRスイッチをHDR100として活用することを助けます。

以下のようにHDRスイッチを活用し、HDR100 InfiniBandの100Gb/sで、Spine、Leafの2段構成を組んだ場合、本記事の冒頭の図のようにスイッチの台数自体を減らすことが可能となりますが、1つの実際のスイッチポートから2つのHDR100ポートが出てくる形となります。そのため、Spine側、及びLeaf側でそれぞれで2ポートのHDR100を自由に接続するためにこのようなH型のケーブルが必要となります。加えて、下記、同じ100Gb/sの、上段のHDR100構成と、下段のEDR構成を比較するとわかるように、ケーブルの本数自体も少なくできます。

このように、HDRスイッチをHDR100ポートとして活用する場合にこのH型AOCケーブルを上手に活用することで、必要なSpineポートとケーブルの数を減らすことで、CAPEX を大幅に節約できます。

さて、駆け足で HDR/HDR100 InfiniBand 対応 LinkXケーブルの概要に触れてきましたが、これらのケーブルは、LinkX ケーブルシリーズが持つ以下の特徴も兼ね備えています。

- InfiniBand の仕様では、10のマイナス12乗の転送品質(BER: Bit Error Rate)が求められるのに対し、今回のHDR対応ケーブルを含め、Mellanox のLinkXシリーズのケーブルでは、その1千倍となる、10のマイナス15乗の転送品質を保証。

- 個々のケーブルにシリアル番号が付記されており、トレーサビリティを確保。

HDR/HDR100 LinkXケーブル一覧

写真 モデル名 概要 長さ

MCP1650-Hシリーズ HDR 200Gb/s QSFP56 ダイレクト・アタッチ・カッパーケーブル 0.5/ 1 / 1.5 / 2 m

MCP7H50-Hシリーズ HDR-to-HDR100 x2 DAC スピリッター 1/ 1.5/ 2 m

MFS1S00-HxxxEシリーズ 200Gb/s HDR QSFP56 MMF Active Optical Cable 3/ 5/ 10/ 15/ 20/ 30/ 50/ 100 m

MFS1S50-HxxxEシリーズ 200Gb/s HDR to 2x100Gb/s HDR100 (QSFP56 to 2xQSFP56) MMFアクティブ・オプティカル・スピリッターケーブル 3/ 5/ 10/ 15/ 20/ 30 m

MFS1S90-Hシリーズ 2x200Gb/s to 2x200Gb/s (2xQSFP56 to 2xQSFP56) MMF アクティブ・オプティカル・クロスコネクト・スピリッター・H-ケーブル 3/ 5/ 10/ 15/ 20/ 30 m

最後までお読みいただきありがとうございました。